Wie Nachbilder erklären, warum wir unsere Umwelt stabil wahrnehmen

Forschungsteam am Exzellenzcluster Science of Intelligence (SCIoI) untersucht, wie das Gehirn trotz der ruckartigen Bewegungen unserer Augen ein stabiles Bild erzeugt. Dafür nutzen sie Nachbilder als experimentelles Werkzeug.

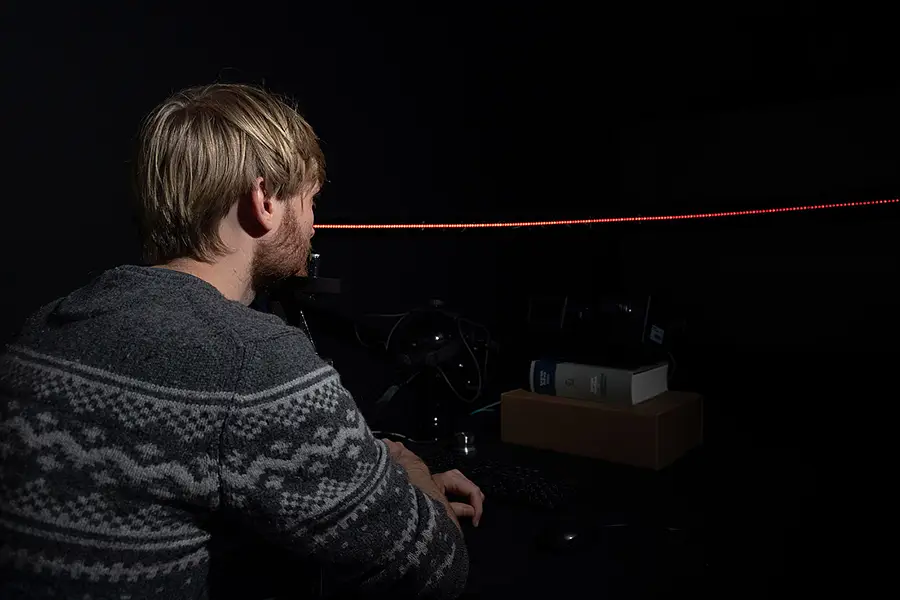

Versuchsaufbau für ein Experiment des Exzellenzclusters Science of Intelligence (SCIoI) in Berlin: Die Blickbewegungen einer Versuchsperson werden in kompletter Dunkelheit mit einem videobasierten Eye-Tracking-System aufgezeichnet. Bildnachweis: Martin Rolfs/HU Berlin

Beteiligtes Bernstein Mitglied: Martin Rolfs

Entgegen der alltäglichen Erfahrung liefern unsere Augen kein kontinuierliches, stabiles Bild der Welt. Sie springen stattdessen mehrmals pro Sekunde in schnellen Bewegungen, sogenannten Sakkaden. Da das Auge die Umwelt auf die Netzhaut projiziert, müsste sich unser Blick eigentlich jedes Mal ruckartig verschieben, wenn sich die Augen bewegen. Unsere Wahrnehmung wäre instabil. Um das zu verhindern, nutzt das Gehirn ausgefeilte Mechanismen.

Eine Studie, die kürzlich in Science Advances veröffentlicht wurde, zeigt nun, dass es gewöhnliche Nachbilder sind – verschwommene Umrisse, die wir etwa sehen, nachdem wir in eine helle Lichtquelle geblickt haben –, die uns Einblicke in diese Stabilitätsmechanismen liefern. Forschende am Exzellenzcluster Science of Intelligence (SCIoI) haben unter der Leitung von Dr. Richard Schweitzer (Humboldt-Universität zu Berlin) und in Zusammenarbeit mit Prof. Dr. Martin Rolfs (Humboldt-Universität zu Berlin), Prof. Dr.-Ing. Thomas Seel (Leibniz Universität Hannover) und Prof. Dr.-Ing. Jörg Raisch (Technische Universität Berlin) mit solchen Nachbildern als experimentelles Werkzeug untersucht, wie genau das Gehirn die visuellen Folgen der Augenbewegungen vorhersagt. Das Ergebnis: Diese Vorhersagen sind erstaunlich präzise, enthalten aber eine systematische kleine Abweichung.

Nachbilder als Fenster zu den internen Signalen des Gehirns

Um die Mechanismen des Gehirns zu untersuchen, mussten die Experimente in völliger Dunkelheit stattfinden, also Bedingungen, die geradezu im Gegensatz zum normalen Sehen stehen. Im Alltag liefert die visuelle Umgebung kontinuierlich Rückmeldungen, die dem Gehirn helfen, die Augenbewegungen einzuschätzen.

Bei den Experimenten saßen die Teilnehmenden im Dunkeln. Zunächst fixierten sie einen hellen Lichtblitz, der ein Nachbild erzeugte. Anschließend blickten sie zu einer zweiten, kurz aufleuchtenden Lichtquelle. Sobald das Nachbild deutlich sichtbar war, erschienen kurze Testlichter an bestimmten Positionen. Die Teilnehmenden gaben an, ob das Nachbild links vom Lichtpunkt, rechts davon oder genau auf gleicher Höhe erschien.

Aus diesen Antworten konnten die Forschenden rekonstruieren, wo das Nachbild wahrgenommen wurde. Gleichzeitig zeichnete ein Eye-Tracking-System präzise auf, wohin die Teilnehmenden tatsächlich blickten, und erlaubte so den Vergleich zwischen Augenbewegung und Wahrnehmung.

Zentrale Erkenntnis: präzise Vorhersage des Gehirns – aber minimale Abweichung

Die Nachbilder folgten den Augenbewegungen erstaunlich genau: Je größer die Augenbewegung, desto weiter schien sich auch das Nachbild im Raum zu verschieben. Dennoch war die Übereinstimmung nicht perfekt.

„Im Durchschnitt entsprach die wahrgenommene Verschiebung des Nachbildes etwa 94 Prozent der tatsächlichen Augenbewegung“, sagt Dr. Richard Schweitzer, Erstautor der Studie. „Die Wahrnehmung folgt den Augenbewegungen also sehr genau – aber eben nicht vollständig.“

Diese kleine Unterschreitung, in der Fachsprache als Hypometrie bezeichnet, zeigte sich bei allen Teilnehmenden und blieb unabhängig von Richtung und Größe der Augenbewegungen stabil. Das deutet darauf hin, dass es sich nicht um zufällige Fehler handelt, sondern um eine systematische Ungenauigkeit in der Vorhersage des Gehirns. Obwohl die Abweichung so gering ist, dass sie im Alltag kaum bewusst wahrgenommen wird, liefert sie wichtige Hinweise darauf, wie das Gehirn das Raumbild nach jeder Augenbewegung aktualisiert.

Warum ein kleiner Fehler durchaus sinnvoll sein könnte

Die minimale Diskrepanz ist möglicherweise ein erwartbares Merkmal des Systems. Denn natürliche Augenbewegungen verfehlen regelmäßig ihr Ziel, etwa aufgrund von Ermüdung der Augenmuskeln. Daher ist es plausibel, dass die interne Schätzung des Gehirns dieses Verhalten widerspiegelt. Wenn Augenbewegungen tendenziell leicht zu kurz geraten, ist es sinnvoll, auch eine etwas kleinere Verschiebung der visuellen Szene zu erwarten. Entscheidend ist also möglicherweise weniger eine perfekte Genauigkeit als vielmehr eine zuverlässige Abstimmung zwischen Bewegung und Wahrnehmung.

Was Nachbilder über visuelle Stabilität verraten

„Nachbilder sind ein nützliches Werkzeug, um zu untersuchen, wie das Gehirn die visuelle Welt stabil hält, indem es die sensorischen Folgen eigener Bewegungen vorhersagt“, sagt Schweitzer. Ein besseres Verständnis dieser Mechanismen könnte über die Grundlagenforschung hinaus relevant sein, etwa auf dem Gebiet der Robotik, der virtuellen Realität oder für die klinische Forschung zu Störungen der Augenbewegung, bei denen eine zuverlässige Verknüpfung von Bewegung und Wahrnehmung entscheidend ist.